流出した実機写真が示すもの——スペックの数字を冷静に読む

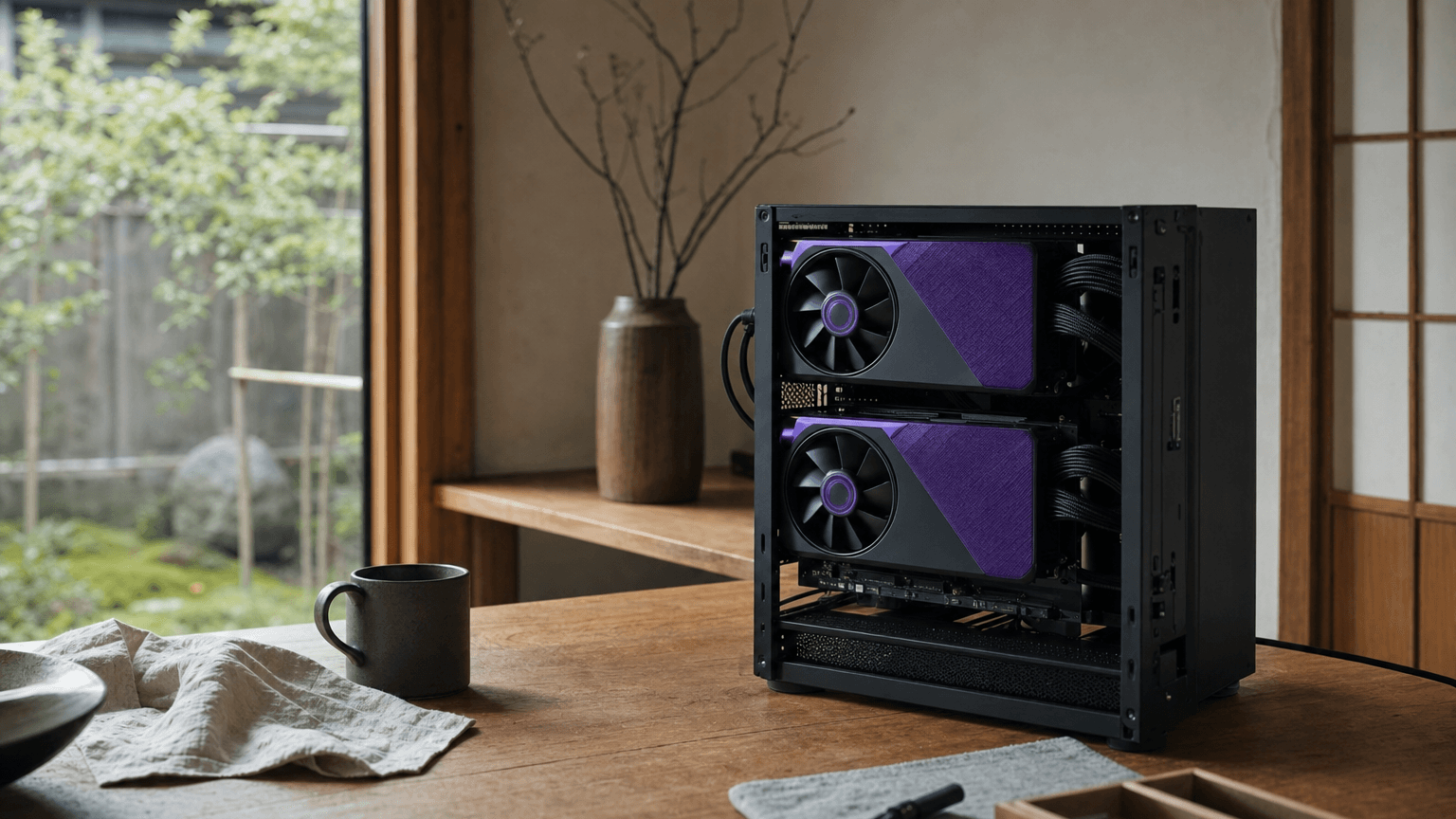

Redditコミュニティ「r/LocalLLaMA」に2025年4月30日付で投稿された一連の写真により、AMDの「Halo Box」と呼称されるデスクトップ筐体の実機が初めて視覚的に確認された。投稿者/u/1ncehostによれば、このユニットはデモ機であり、OSはUbuntuで動作、筐体側面に実装されたライトストリップはプログラマブル仕様だという。Sourceが報じているのはその程度の情報だが、ここから読み取れる文脈は少なくない。

Ryzen AI Max+ 395は、AMDのStrix HaloダイをベースとするAPUであり、CPU側に16コア(Zen 5アーキテクチャ)、GPU側にRDNA 3.5世代の40CUを統合し、最大128GBのLPDDR5X統合メモリをサポートする。メモリ帯域幅は理論値で約256GB/sとされており、これはNVIDIA RTX 4090(384GB/s)には届かないが、従来のAPUが提供してきた帯域幅と比較すれば大幅な改善だ。ただし「大幅な改善」と「十分」は別の話だ。

ローカルLLM推論の文脈で128GBという数字が持つ意味は明確だ。70Bクラスのモデル(例:Llama 3 70B)をFP16で動かすには約140GBのメモリが必要であり、Q4量子化でおよそ35〜40GBに圧縮できる。128GBあれば量子化なしで70Bモデルを動かすことも理論上は可能であり、これがr/LocalLLaMAコミュニティが反応した理由だ。しかし帯域幅の壁は依然として存在する。256GB/sという数字は、トークン生成速度に直結するメモリ帯域幅としては、Apple M3 Ultra(800GB/s超)の3分の1以下にすぎない。

デモ機という事実——量産・歩留まり・価格への疑問

ここで重要なのは「デモ機」という点だ。AMDが公式に発表した製品ではなく、流出した写真から確認できる情報は限られている。Ubuntuで動作するという事実はLinuxドライバの成熟度を示唆するが、ROCmスタックがStrix HaloのiGPUで安定動作するかどうかは、デモ環境と量産環境では話が変わる可能性がある。

過去の類似事例を引くなら、2018年のIntel 10nmプロセス遅延の構図が参考になる。Intelは2015年から「10nmは順調」と繰り返し、実際に量産出荷が始まったのは2019年のIce Lakeからだ。デモ機の存在は量産準備の指標にはなるが、歩留まりと価格設定が伴わなければ市場に届かない。AMDのStrix Haloダイはダイサイズが大きく(推定500mm²超)、TSMCの4nmノードでの歩留まりが量産コストに直結する。公式な歩留まりデータは現時点で開示されていないが、ダイサイズと製造ノードの関係から、歩留まり改善が価格に反映されるまでに時間を要すると推測される。

また、筐体デザインについて言えば、プログラマブルLEDライトストリップの搭載はコンシューマー向けを意識した設計と見られる。しかし128GBメモリ統合のAPUシステムがコンシューマー価格帯に収まるかどうかは別問題だ。比較対象として、Apple Mac Studio(M3 Ultra、192GB)の価格は日本市場で60万円超に達する。AMDがこの価格帯に対抗するポジションを取るのか、あるいはワークステーション寄りの価格設定を選択するのかは、現時点では不明だ。

さらに言えば、Halo Boxという名称自体がAMD公式のものかどうかも確認されていない。コミュニティが便宜的に使っている呼称である可能性があり、製品名・型番・発売時期・価格のいずれも公式一次情報(AMDの決算資料やSEC提出書類)では現時点で確認できていない。投資判断や購買判断の材料として扱うには情報が不足しすぎている。

ローカルLLM市場における位置付けと競合との比較

ローカルLLM推論専用ハードウェアという文脈では、競合の動向も無視できない。NVIDIAはDGX Sparkを2025年に発表しており、GB10 Superchipを搭載し128GBのメモリを持つ。価格は約3,000ドルとされており、CUDA/TensorRTエコシステムとの親和性はAMDのROCmを大きく上回る。一方でAppleのM4 Ultraは最大192GBの統合メモリと高帯域幅を武器に、macOSエコシステム上でのLLM推論で実績を積んでいる。

AMD Halo Boxが対抗できる差別化ポイントとして考えられるのは、x86アーキテクチャによるWindowsおよびLinuxとの親和性、そしてRyzenブランドによるコミュニティ知名度だ。ROCmはここ数年で改善が進んでいるが、PyTorchやllama.cppとの統合品質においてCUDAとの差は依然として存在すると見ている。Ubuntuで動作するデモ機の存在はROCm対応の方向性を示唆するが、エコシステムの成熟度は一朝一夕では変わらない。

コスト面での試算を行うなら、仮に本製品が2,000〜4,000ドルの価格帯で登場した場合、70Bモデルをローカルで動かしたいユーザーにとってのROIは、クラウドAPI費用との比較で成立するかどうかが鍵になる。OpenAI APIでGPT-4oクラスのモデルを月間100万トークン使用した場合のコストは数ドル〜十数ドル程度であり、プライバシー要件やオフライン要件がなければクラウドの方が経済合理性は高い。ローカルLLM需要が「プライバシー重視」「オフライン環境」「継続的高頻度使用」のユーザーに限定されている現状では、市場規模は熱狂的なコミュニティの声ほど大きくない可能性がある。

結論——デモ機の写真は「期待」であって「製品」ではない

流出した写真が示すのは、AMDがStrix Haloベースの統合型デスクトップ筐体を開発中であるという事実だ。128GBという数字はローカルLLM用途において意味を持ち、Ubuntuでの動作確認はLinux対応の姿勢を示す。しかし歩留まり、量産価格、ROCmエコシステムの完成度、そして正式な発売時期——これらはいずれも現時点では不明だ。

2021年のIntel Arc GPUもデモ段階では期待を集めたが、量産後のドライバ品質と性能実測値がコミュニティの期待を裏切った経緯がある。AMDのHalo Boxが同じ轍を踏まないという保証はどこにもない。プログラマブルLEDが光り輝いていても、歩留まりと帯域幅の数字は光らない——それだけの話だ。

関連リンク

- NVIDIA DGX Spark(パソコン工房):GB10 Grace Blackwell Superchip搭載・128GB統合メモリのデスクトップAIスーパーコンピューター、記事内の競合比較で参照されている製品。

- Apple Mac Studio(M3 Ultra)— Apple Japan公式:最大256GBユニファイドメモリを搭載し、記事内でローカルLLM用途の比較対象として言及されているデスクトップ機。