FP8 量子化とは何か——数字で整理する

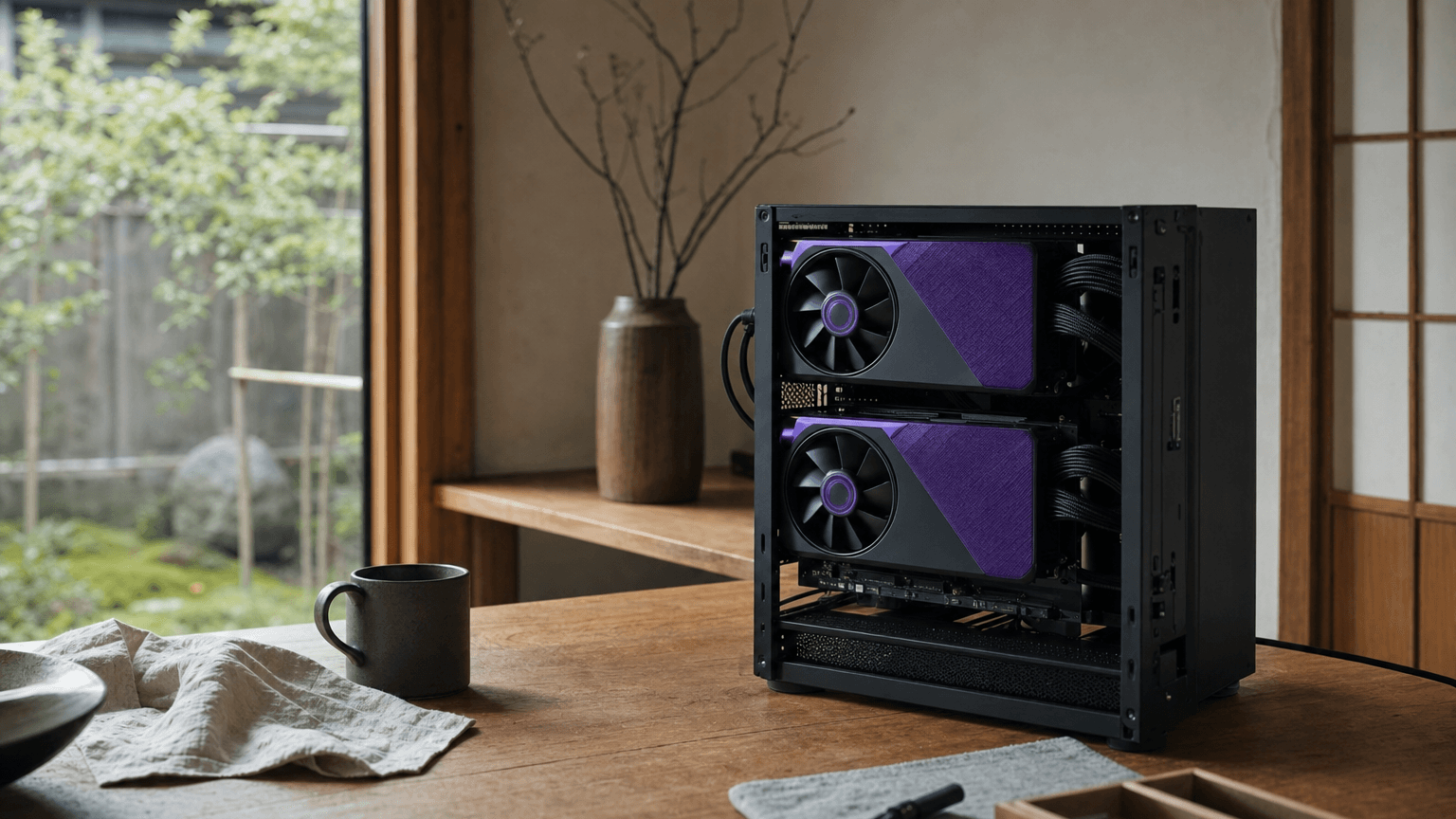

まず前提を整理しておく。FP8(8ビット浮動小数点)量子化は、BF16 比でモデルのメモリフットプリントをおよそ半減させる手法だ。27B パラメータモデルを BF16 で保持すると約 54GB の VRAM が必要になる。FP8 に落とせば理論上 27GB 前後まで圧縮でき、24GB VRAM の RTX 3090 を 2 枚(合計 48GB)構成で十分に収まる計算になる。これは「画期的」でも「ゲームチェンジャー」でもなく、単純な算数だ。

Red Hat AI が公開したモデルは Hugging Face の RedHatAI/Qwen3.6-27B-FP8 で確認できる。ベースは Alibaba の Qwen3.6-27B であり、Red Hat はそこに FP8 量子化を施してオープンに配布している形だ。Reddit の LocalLLaMA コミュニティでも「デュアル 3090 勢に最適」として話題になっている。

過去の類似事例を引くなら、2023年に TheBloke(現 Bartowski)が LLaMA-2 系モデルの GPTQ・GGUF 量子化を大量放流した局面と構図は同じだ。当時も「量子化で民主化」という文脈で語られたが、実態は「A100 を持てないユーザーが次善策として使う」という話にすぎなかった。今回も本質は変わらない。

Red Hat が量子化モデルを配布する理由——ROI の観点から

Red Hat が純粋な善意でモデルを配布しているとは考えにくい。同社の AI 戦略は Red Hat OpenShift AI(旧 RHODS)を中心に据えており、エンタープライズ顧客が自社インフラ上で LLM を動かすユースケースを取り込むことが目的だ。FP8 量子化モデルを OSS として配布することで、(1) vLLM・TGI などの Red Hat 推奨スタックとの親和性をアピールし、(2) エンタープライズ商談の入口として機能させる——という二段構えの ROI 設計と見ている。

実際、vLLM は FP8 をネイティブサポートしており、Red Hat が量子化フォーマットとして FP8 を選択したのは偶然ではない。GPTQ や AWQ と比較して、FP8 は推論レイテンシのオーバーヘッドが小さく、H100 や A100 系の Transformer Engine との相性も良い。ただし RTX 3090 は Ampere 世代であり、FP8 のハードウェアアクセラレーションは Ada Lovelace(RTX 40 系)以降で本格化する。3090 で FP8 を動かす場合、ソフトウェアエミュレーションが入る可能性があり、理論値通りのスループットが出るかどうかは現時点で不明だ——少なくとも元ソースには具体的なベンチマーク数値は示されていない。

2024年に Intel が Gaudi 2 向けに量子化モデルを積極配布した際も、「エコシステム形成のための先行投資」という同じ構図だった。歩留まりや精度劣化の数値を開示しないまま「使えます」と言うのは、業界の悪い慣習だと私は見ている。

精度劣化とユーザーへの実際的含意

量子化には必ず精度劣化が伴う。FP8 は INT4 や INT8 よりも情報損失が少ないとされるが、タスク依存性が高い。数学的推論やコーディングタスクでは BF16 比で数ポイントのベンチマーク低下が報告されているケースもある。Qwen3.6-27B の FP8 版について、Red Hat が公式に精度評価(MMLU、HumanEval、GSM8K 等)を開示しているかどうかは、現時点で Hugging Face のモデルカードを確認する必要がある。元ソースの Reddit スレッドにはベンチマーク比較は掲載されておらず、「デュアル 3090 で動く」という事実のみが強調されている点は注意が必要だ。

デュアル RTX 3090 構成のユーザーにとっての実際的な選択肢を整理すると、(1) Qwen3-14B を BF16 で動かす、(2) Qwen3-30B-A3B(MoE)を量子化で動かす、(3) 今回の Qwen3.6-27B FP8 を使う——という三択になる。どれが最適かはユースケース次第だが、パラメータ数だけで判断するのは危険だ。MoE アーキテクチャの Qwen3-30B-A3B は実効パラメータが 3B 程度であり、推論コストは全く異なる。

2022年の BLOOM 176B 量子化騒動を思い出す。「家庭用 GPU で動く」という触れ込みで注目を集めたが、実用的な推論速度が出るまでに半年以上のエコシステム整備が必要だった。今回の規模感は全く異なるが、「動く」と「使える」の間には常にギャップがある。

結論——「ついに」という感嘆符の重さを問う

Red Hat による Qwen3.6-27B FP8 の公開は、ローカル推論コミュニティにとって実用的な選択肢が一つ増えたという事実だ。デュアル RTX 3090 ユーザーが 27B クラスのモデルを手元で動かせる環境が整いつつあるのは確かだし、Red Hat がエンタープライズ向け量子化モデルの配布を継続する姿勢を示したことにも意味はある。

しかし元ソースのタイトルにある「Finally(ついに)」という感嘆符には苦笑を禁じ得ない。FP8 量子化自体は 2023年から産業界で実用化されており、27B モデルをデュアル 3090 に収めるのは技術的に新しい話ではない。精度劣化の定量評価もなく、推論スループットのベンチマークもない状態で「ついに」と叫ぶのは、20年間このサプライチェーンを見てきた私には少々気恥ずかしい光景だ。モデルカードに数字を並べてから「ついに」と言ってほしいものだ。

関連リンク

- RedHatAI/Qwen3.6-27B-FP8(Red Hat AI × Hugging Face):記事の主題となる Red Hat AI 公開の FP8 量子化モデル本体ページ。

- Qwen/Qwen3.6-27B(Alibaba Qwen × Hugging Face):FP8 版のベースとなる Alibaba 公式の BF16 オリジナルモデルページ。